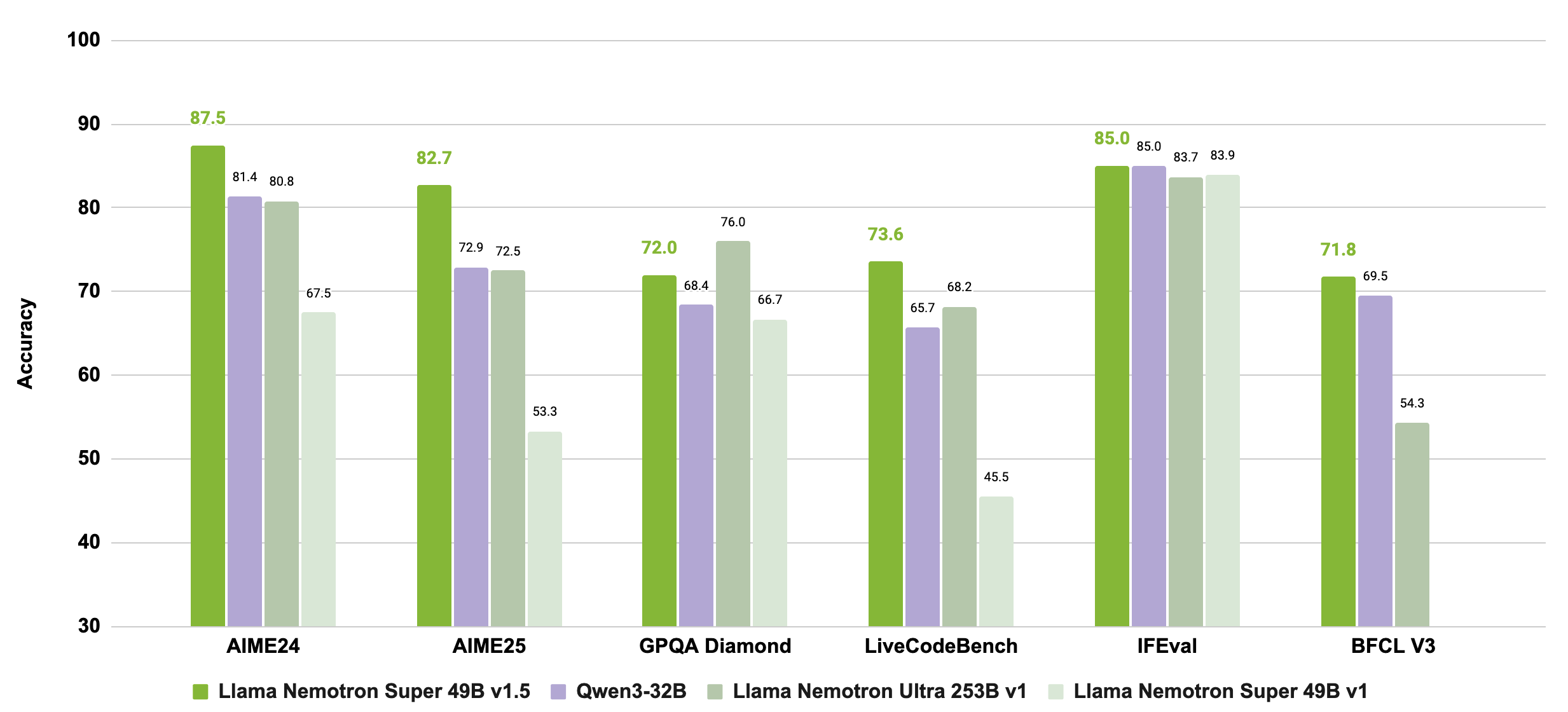

엔비디아가 2025년 7월 발표한 오픈소스 대형언어모델(LLM)이다. 복잡한 추론 작업에 최적화된 모델이며 정식 명칭은 Llama-3.3-Nemotron-Super-49B-v1.5 이다. 원본 모델인 Meta의 Llama-3.3-70B-Instruct를 기반으로 경량화 및 최적화를 거친 49B 크기의 모델이다.

복잡한 수학적 추론, 과학 문제 해결, 코드 생성 및 논리적 추론을 위한 성능 향상에 중점을 두고 개발되었다. NVIDIA의 고유한 Neural Architecture Search(NAS) 기술을 통해 이전 모델(V1)보다 약 3배의 추론 속도를 향상시켰다. Transformer 블록에 attention skip 기법이나 다양한 크기의 FFN을 적용한 결과이다.

사용자가 추론 모드를 토글할 수 있다는 점이다. 추론 명령어를 통해 reasoning 모드를 활성화하면 모델은 내부적으로 사고 과정을 포함하며 상세한 중간 과정과 논리를 응답에 추가한다. 이는 STEM 문제 풀이, 프로그래밍 코드 생성, 복잡한 질문 해결에 유용하다. 반대로 reasoning를 비활성화하면 응답이 더 간결하고 효율적으로 이루어져 일반적인 질의응답에 적합하다.

학습과정은 크게 3단계로 구성됐다. 첫번째로는 NAS 기반 구조 최적화 단계로, 모델 내부의 블록 구조를 경량화하면서 성능을 극대화했다. 두번째로는 지도학습 단계로 수학적 추론, 코드 생성 등 특정 작업에 대한 성능 향상을 목표로 인간의 선호도를 반영한 데이터로 훈련했다. 마지막으로 강화학습을 적용해 인간 평가를 통핸 선호도 최적화(RPO, REINFORCE)를 수행하여 응답의 질적 수준을 높였다.

단일 NVIDIA H100이나 H200 GPU에서 운영이 가능하다. 모델 가중치 및 코드가 NVIDIA Open Model License로 공개되어서 상업적 활용이 자유롭다. 이로 인해 기업, 연구기관, 개발자 모두 고성능 모델을 자유롭게 사용하고 응용 프로그램이나 서비스 구축이 가능해졌다.

Llama-3.3-70B-Instruct에서 파인튜닝을 통해서 성능이 얼마나 향상될 수 있는지 볼 수 있는 지표가 될 것으로 보여진다.

NVIDIA에서 Llama 3.3 Nemotron Super 49B v1.5 모델을 오픈소스로 공개했다. 파인튜닝을 했던 방법과 툴체인, 그리고 파인튜닝을 했던 데이터셋까지 공개하고 있다. 특히 자체적으로 개발한 합성 데이터셋과 복합적인 다단계 후처리 학습을 통해 추론, 코딩, 수학, 에이전트 작업 등의 핵심 역량이 크게 강화되었다.

인공지능 업체들이 오픈웨이트형태로 공개된 인공지능 모델이 마이너버전을 업그레이드 하면서 성능이 크게 향상되는 경우를 종종 보이고 있다. 아마도 고품질의 합성데이터를 통한 파인튜닝을 해서 성능이 크게 향상되고 데이터 증류기법을 통해서 모델의 크기를 줄이는 것으로 생각이 된다.

https://huggingface.co/nvidia/Llama-3_3-Nemotron-Super-49B-v1_5

https://arxiv.org/abs/2411.19146

https://huggingface.co/datasets/nvidia/Nemotron-Post-Training-Dataset-v1

'IT이야기' 카테고리의 다른 글

| 알리바바, 고화질 1080p 지원하는 Wan 2.2 공개 (1) | 2025.08.03 |

|---|---|

| 알리바바, Qwen3-235B-A22B-Thinking-2507 (1) | 2025.08.01 |

| 텐센트, 3D 월드를 생성 모델 HunyuanWorld 1.0 공개 (0) | 2025.07.30 |

| ZhipuAI, 신규 LLM모델 GLM 4.5 공개 (1) | 2025.07.29 |

| 알리바바, Qwen3 Coder 와 Qwen Code 공개 (0) | 2025.07.24 |